La Unión Europea, primer regulador mundial de la IA. El pasado 9 de diciembre (2023) el Consejo y el Parlamento europeo llegaron a un acuerdo sobre las primeras normas para la IA a nivel mundial. Con esto Europa, muy rezagada con el desarrollo de la IA respecto a Estados Unidos y China, e incluso con respecto a países más pequeños (Reino Unido, Canadá, Israel…), lograba el liderazgo normativo.

| Según la Secretaria de Estado Española para la Digitalización y la Inteligencia Artificial, el acuerdo intenta un equilibrio delicado entre impulsar la innovación y el uso de la IA en Europa, respetando los derechos fundamentales de los ciudadanos. El objetivo de la Ley de Inteligencia Artificial impulsada por la UE buscaría garantizar que los sistemas de IA en el mercado europeo sean seguros, respeten los derechos fundamentales y los valores de la UE, y estimulen la inversión y la innovación en IA en Europa. |

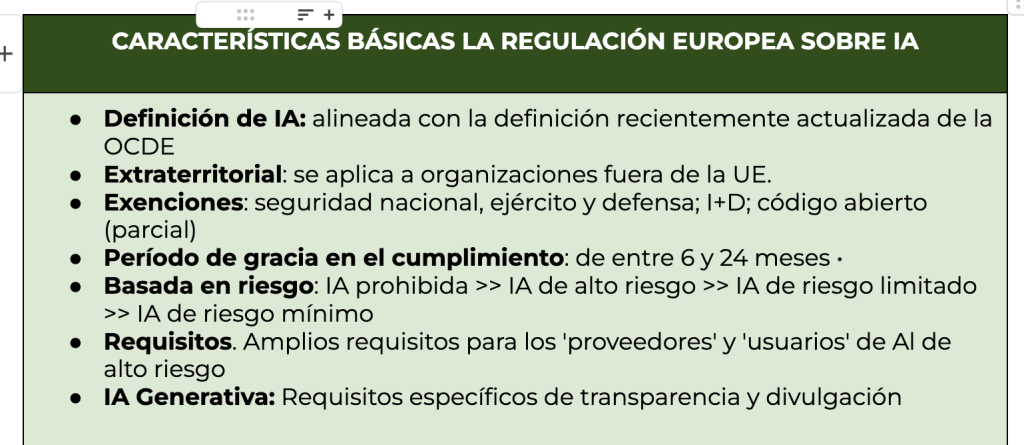

Algunas características de la normativa aprobada (Consejo de la UE, 2023):

- Enfoque basado en el riesgo. La Ley regula la IA basándose en su capacidad de causar daño a la sociedad, aplicando reglas más estrictas a mayor riesgo. Es la primera propuesta legislativa de este tipo en el mundo y podría establecer un estándar global para la regulación de la IA.

- Elementos principales de la Ley (acuerdo):

- Reglas para modelos de IA de propósito general y sistemas de alto riesgo.

- Sistema de gobernanza revisado con ciertos poderes de ejecución a nivel de la UE.

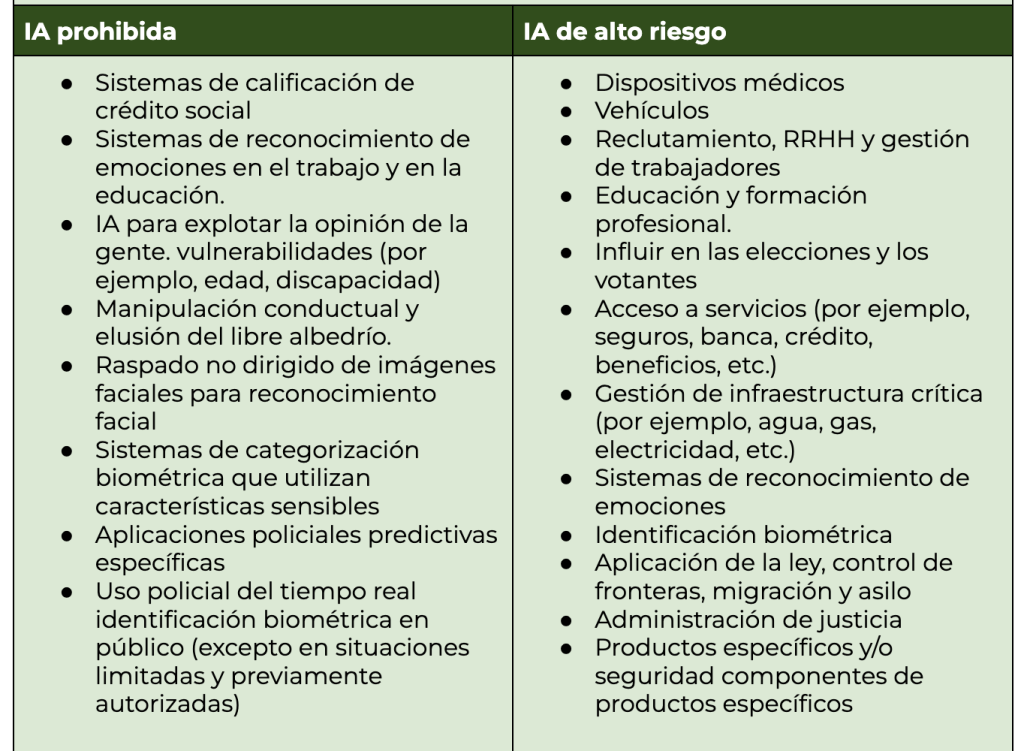

- Extensión de la lista de prohibiciones, con excepciones para la identificación biométrica remota por autoridades policiales bajo salvaguardias.

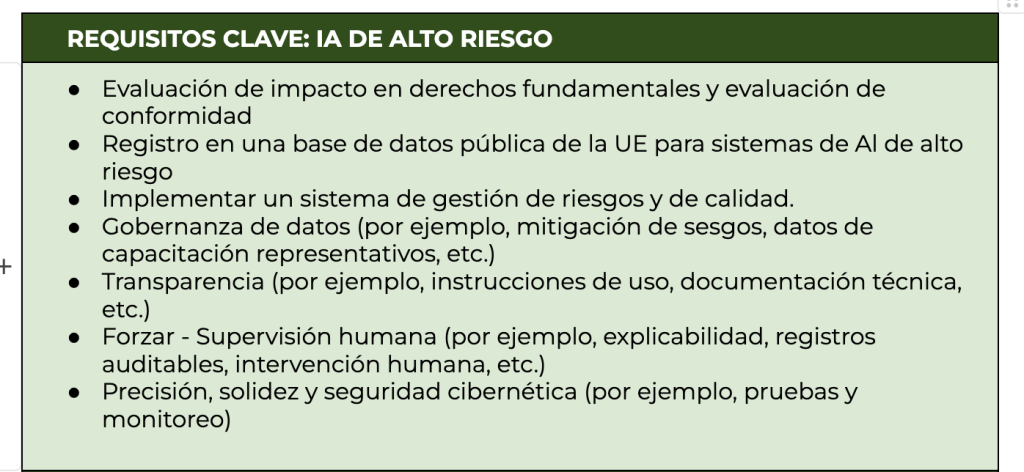

- Protección de derechos mediante la evaluación de impacto en derechos fundamentales antes de usar un sistema de IA de alto riesgo.

- Clasificación de sistemas de IA y prácticas prohibidas. La Ley introduce una capa horizontal de protección, incluyendo una clasificación de alto riesgo y prohibiendo ciertas prácticas de IA, como la manipulación del comportamiento cognitivo.

- Excepciones para aplicaciones de la Ley.

- No se aplica en áreas fuera del ámbito de la ley de la UE.

- Exclusión de sistemas utilizados sólo con fines militares o de defensa.

- No se aplica a sistemas de IA utilizados exclusivamente para investigación e innovación.

- Excepciones para las autoridades de aplicación de la Ley. Se permiten ciertos usos de sistemas de IA por las autoridades policiales, sujetos a salvaguardias adecuadas.

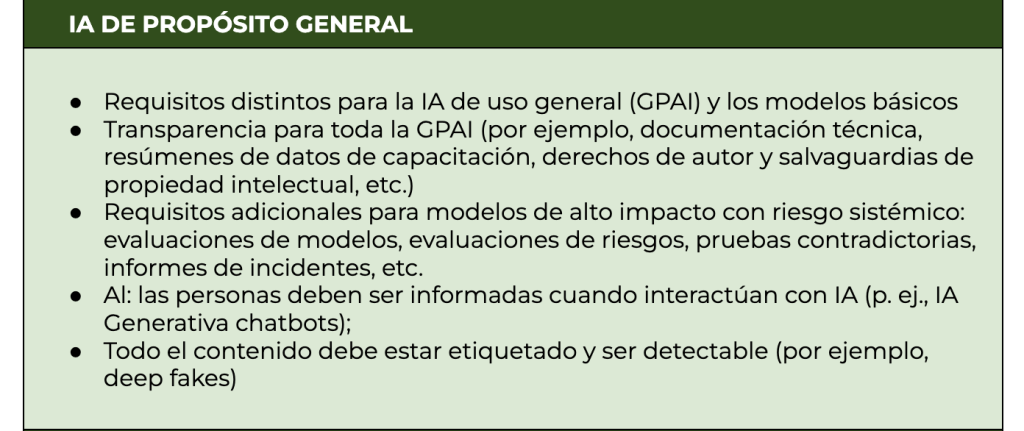

- Sistemas de IA y modelos fundamentales. Se han añadido nuevas disposiciones para abordar sistemas de IA de uso general y modelos fundamentales, con obligaciones específicas de transparencia.

- Gobernanza. Establecimiento de una Oficina de IA dentro de la Comisión para supervisar los modelos de IA más avanzados y un consejo de IA para la coordinación y asesoramiento.

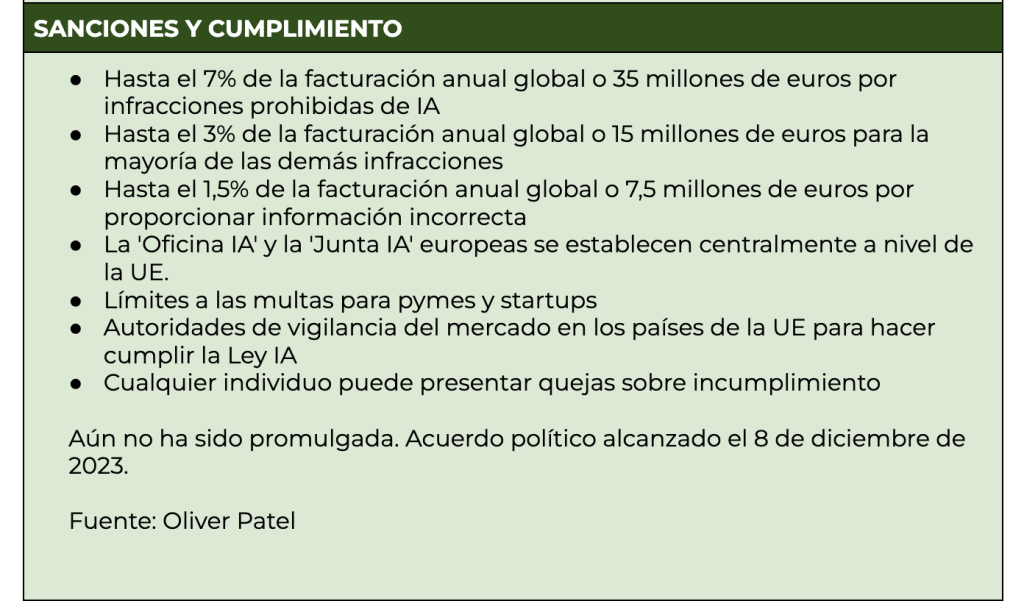

- Penalizaciones y protección de derechos fundamentales. Se establecen multas para las violaciones y se requiere una evaluación de impacto en derechos fundamentales antes de poner un sistema de IA de alto riesgo en el mercado.

- Medidas de apoyo a la Innovación. Se han modificado las disposiciones para fomentar un entorno legal más favorable a la innovación, como los «sandbox» regulatorios para la IA.

La Ley debería aplicarse dos años después de su entrada en vigor, con excepciones para disposiciones específicas. El texto completo aún necesita ser confirmado y adoptado formalmente por los colegisladores.

Resumen

Fuente: La inteligencia artificial en las universidades:retos y oportunidades

Grupo 1MillionBot

El debate abierto en Linkedin